Marketwatch: KI und SEO

SEO verändert sich ständig und gefühlt immer schneller. Längst ist klar, dass KI das Feld nachhaltig beeinflusst. Da diese Veränderungen auf unsere tägliche Arbeit elementaren Einfluss haben und es für den Einzelnen und die Einzelne schwer ist, den Überblick zu behalten, wollen wir die wichtigsten Veränderungen über den MarkOp Marketwatch dokumentieren und einordnen. Deshalb folgen hier und in unserem WhatsApp-Kanal regelmäßig Updates und Erkenntnisse, die via LinkedIn, Newslettern, Podcasts oder News-Outlets aus der SEO-Branche an uns herangetragen werden – eingeordnet von unseren SEO-Experten Henry und Alex.

Hinweis: Für eine einfachere Navigation haben wir uns dazu entschieden, in diesem Beitrag nur die aktuellen Meldungen aus dem Jahr 2026 zu veröffentlichen. Alle Meldungen und Einordnungen aus dem Jahr 2025 findet ihr im Archiv-Beitrag!

Updates aus dem Mai 2026

Update vom 02.05.2026: Neue Google-Vorgaben zu optimalem Webdesign für Agenten

Laut web.dev sollten Websites für KI-Agenten klar strukturiert, semantisch aufgebaut und visuell stabil sein. Relevant ist das, weil nicht nur menschliche User Websites nutzen. Immer mehr Aufgaben werden an KI-Agenten ausgelagert, die selbstständig Handlungen (z. B. Recherche, Reservierungen etc.) durchführen.

KI-Agenten interpretieren Websites über HTML, Screenshots und den Accessibility-Tree. Je sauberer diese Signale sind, desto zuverlässiger können sie navigieren und Aufgaben ausführen. Davon profitieren zugleich Usability und Barrierefreiheit für Menschen. Genannt werden vor allem diese Tipps:

sichtbare Aktionen in der Oberfläche

stabiles Layout

keine Overlays über interaktiven Elementen

semantisches HTML mit <button> und <a>, alternativ passende role- und tabindex-Attribute

cursor: pointer festlegen

korrekt verknüpfte Labels bei Formularen sowie ausreichend große klickbare Elemente.

Wenn Agenten Aufgaben wie Recherche, Buchungen oder Formularprozesse übernehmen, werden saubere Interface- und Code-Strukturen zum Wettbewerbsfaktor. Wer seine Website nicht agentenfreundlich gestaltet, riskiert künftig nicht nur schlechtere Nutzererlebnisse, sondern auch Sichtbarkeits- und Conversion-Nachteile in einer zunehmend KI-vermittelten Webnutzung.

Alexander Beth

Update vom 01.05.2026: Preferred Sources in allen Sprachen verfügbar

Wer regelmäßig Nachrichten liest, hat es vielleicht schon mitbekommen: Viele Publisher machen gerade darauf aufmerksam, die Nachrichtenseite als bevorzugte Quelle bei Google zu hinterlegen. Der Internetriese aus Amerika hat die Funktion „Preferred Sources“ nun für alle Sprachen ausgerollt. Dies berichtet SEO Südwest.

Damit ist die Funktion auch in deutschsprachigen Suchergebnissen verfügbar und erlaubt es Nutzer:innen, bevorzugte News-Quellen für Schlagzeilen auszuwählen. Google zufolge ist die Klickwahrscheinlichkeit bei als bevorzugt markierten Quellen doppelt so hoch.

Updates aus dem April 2026

Update vom 30.04.2026: Suchanfragen bei Google auf Allzeithoch

Update vom 28.04.2026: Wie stabil sind Quellen in KI-Suchergebnissen?

Update vom 24.04.2026: Neue Daten zur Click Through Rate in Google AI Overviews

Update vom 22.04.2026: Welchen Einfluss hat die Sprache auf KI-Zitierungen?

Update vom 20.04.2026: Best Practices für „Read more“-Links in den Google SERPs

Update vom 14.04.2026: Wie KI-generierte Fehlinformationen sich selbst füttern

Update vom 13.04.2026: Was passiert zwischen einer KI-Suchanfrage und der Zitierung?

Update vom 07.04.2026: Der Einfluss von KI-Produktempfehlungen auf Kaufentscheidungen

Update vom 30.04.2026: Suchanfragen bei Google auf Allzeithoch

Laut SEO Südwest hat Google im ersten Quartal 2026 ein Allzeithoch bei den Suchanfragen erreicht, gestützt durch KI-Funktionen wie AI Overviews und AI Mode. Alphabet meldete zugleich starkes Wachstum:

109,9 Milliarden US-Dollar Umsatz (+22 Prozent)

62,57 Milliarden US-Dollar Nettogewinn (+81 Prozent).

Künftig sollen vor allem Personalisierung, agentenbasierte Funktionen (z. B. Reservierungen), multimodale Suche (Search Live) und geringere Latenzen die Nutzung der Google-Suche weiter stärken. Weitere Neuerungen wurden für die Google I/O im Mai angekündigt.

Update vom 28.04.2026: Wie stabil sind Quellen in KI-Suchergebnissen?

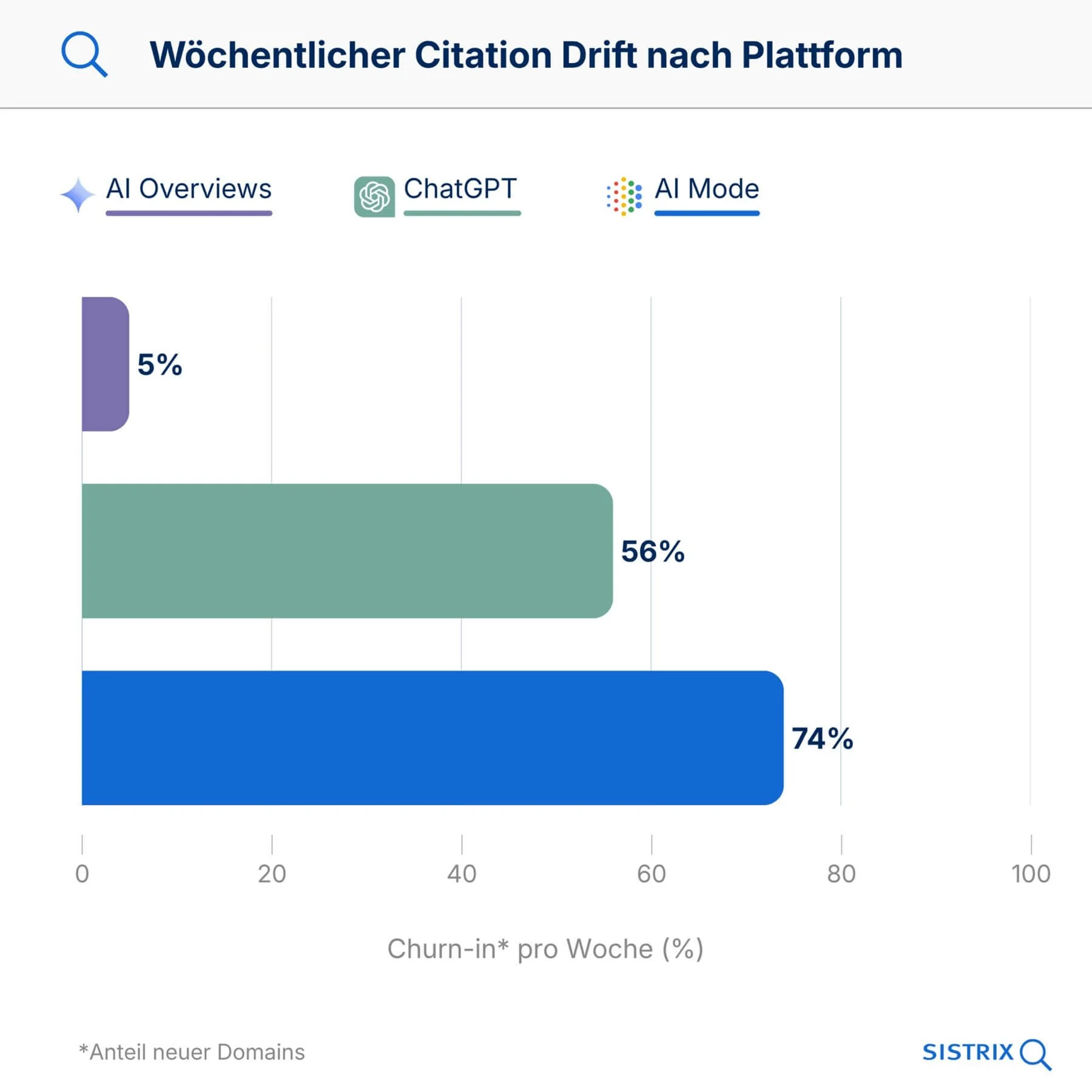

SISTRIX zeigt in einer neuen Analyse anhand von 82.619 Prompts den sog. „AI Citation Drift“, also wie stabil Quellen in der KI-Suche genutzt werden. Über einen Zeitraum von 17 Wochen wurden dabei Googles AI Overviews und AI Mode sowie ChatGPT betrachtet. Die wichtigsten Erkenntnisse sind dabei:

Kern und Karussell: 86 % der Antworten enthalten einen kleinen stabilen Domain-Kern, während der übrige Teil zu 89 % pro Woche rotiert. Für GEO zählt daher, ob eine Domain im Kern oder nur im wechselnden Umfeld erscheint.

Plattformenunterschiede: AI Overviews sind bei rund der Hälfte der Queries komplett stabil, AI Mode rotiert zu 56 % pro Woche, ChatGPT zu 74 %. Eine einheitliche GEO-Logik für alle Plattformen greift deshalb zu kurz.

Stabile Marken-Domains: Bei 43 % der Marken-Queries ist die eigene Domain über alle 17 Wochen hinweg präsent. Andere mitzitierte Quellen wechseln dagegen mit 70 % pro Woche. Marken bleiben, Begleitquellen kommen und gehen.

News bleiben nur kurz: Nur 1,4 % der zitierten Nachrichtenartikel bleiben dauerhaft im Citation-Set. Evergreen-Content ist für nachhaltige Citation-Sichtbarkeit deutlich belastbarer als News.

Citation Drift: Über sechs Länder hinweg bleiben die Drift-Raten mit 54-59 % konstant hoch – ohne Abschwächung über den Untersuchungszeitraum. Die Instabilität ist also strukturell, nicht nur ein temporärer Starteffekt.

Update vom 24.04.2026: Neue Daten zur Click Through Rate in Google AI Overviews

Seer Interactive hat seine CTR-Studie zu Googles AI Overviews mit Daten für das erste Quartal 2026 aktualisiert: Dafür wurden 53 Brands, 5,47 Mio. Queries und 2,43 Mrd. organische Impressions untersucht.

Der 2025 beobachtete CTR-Rückgang bei AI-Overview-Queries setzte sich Anfang 2026 nicht fort: Die organische CTR auf AI Overviews stieg von 1,3 % im Dezember 2025 auf 2,4 % im Februar 2026.

Gleichzeitig bleiben Zitationen relevant: Wer in der KI-Übersicht der Google SERPs genannt wird, erzielt laut Studie deutlich mehr Klicks pro Impression als nicht zitierte Marken, bleibt aber unter Nicht-AIO-Niveau.

Update vom 22.04.2026: Welchen Einfluss hat die Sprache auf KI-Zitierungen?

Eine Analyse von Profound zeigt auf Basis von 3,25 Milliarden KI-Zitationen aus März 2026, dass die Sprache einer Anfrage die Quellenlage von KI-Antworten stark verändert. Besonders Google AI Overviews zitieren Social-Quellen wie YouTube, Reddit oder Instagram je nach Sprache mit stark variierender Häufigkeit. ChatGPT nutzt außerhalb englischer Märkte insgesamt weniger Social-Quellen, bleibt aber stark auf Reddit fokussiert.

Die Auswertung von Profound zeigt, dass internationale Sichtbarkeit anhand englischer Prompts oder einer einheitlichen Globalstrategie nicht sinnvoll bewertet werden kann. Je nachdem, um welchen Zielmarkt es sich handelt, müssen die Sprache und das nationale Suchverhalten in der eigenen GEO-Strategie berücksichtigt werden.

Henry Seyffert

Update vom 21.04.2026: Neue Ansicht im Google AI Mode

Laut einem LinkedIn-Post von Chris Long ändert Google (über die neueste Chrome-Version) das Klickverhalten in AI-Mode: Link-Klicks führen nicht mehr in einen vollständigen Seitenwechsel, sondern öffnen eine „Side-by-side“-Ansicht – rechts die Zielseite, links bleibt AI Mode als Sidebar aktiv. Das hält Nutzer:innen stärker im AI-Interface, macht CTR/Attribution potenziell schwieriger und erhöht Googles Kontrolle.

Vielfach wurde in der Vergangenheit bereits über den Einbruch von Klickzahlen in der KI-Suche berichtet. Mit diesem neuen Konzept geht noch mehr Kontrolle für die Website-Betreiber:innen verloren. Ein Klick im AI-Mode führt zwar zu Sichtbarkeit der Website durch die neue Ansicht, allerdings bleibt das Nutzerverhalten für die Seitenbetreiber:innen eine Black Box. Wer Handlungen (z. B. Kauf, Terminbuchung etc.) auf der Website ausführen lassen will, sollte sicherstellen, dass diese auch ohne einen direkten Besuch der Seite ausführbar sind.

Alexander Beth

Update vom 20.04.2026: Best Practices für „Read more“-Links in den Google SERPs

Google hat in seiner Search Central Dokumentation neue Best Practices für die seit Dezember 2025 auf den Suchergebnisseiten eingesetzten „Read more“-Links veröffentlicht. Um die Wahrscheinlichkeit zu erhöhen, dass solche Links (im Deutschen als „Weitere Informationen“) für die eigenen SERP-Snippets ausgespielt werden, sind laut Google vor allem drei Dinge zu beachten:

Inhalte müssen sofort auf der Seite sichtbar sein, sollten also nicht hinter einem ausklappbaren Bereich o. Ä. verborgen sind.

Die Scrollposition der Nutzer:innen sollte beim Laden der Seite nicht mit JavaScript gesteuert werden.

Wenn beim Seitenaufbau History-API-Aufrufe ausgeführt oder window.location.hash-Änderungen vorgenommen werden, darf das Hash-Fragment nicht aus der URL entfernt werden.

Die „Read more“- bzw. „Weitere Informationen“-Links bieten eine zusätzliche Möglichkeit, organischen Traffic über die klassischen Suchergebnisse von Google zu erzielen, indem sie als Ersatz für die Meta-Beschreibung direkt auf eine Textstelle verweisen. Mit den richtigen Inhalten können so Website-Besucher:innen gewonnen werden, die über die AI Overviews hinaus nach spezifischen Informationen suchen. Es lohnt sich für den eigenen SEO-relevanten Content also, die Best Practices von Google umzusetzen.

Henry Seyffert

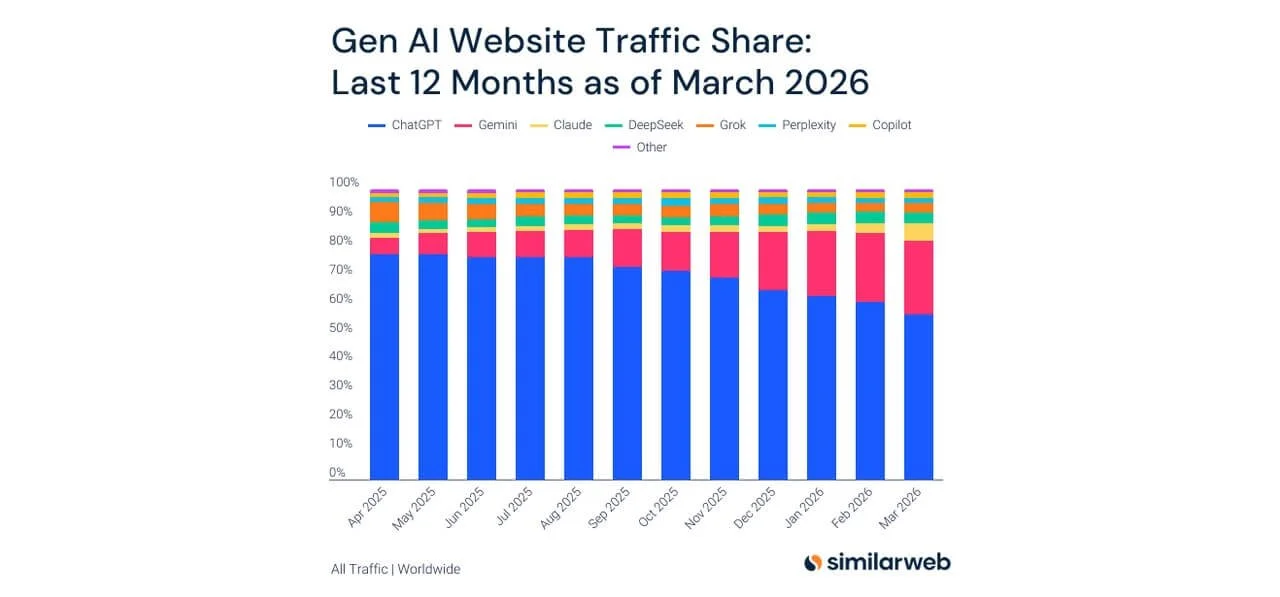

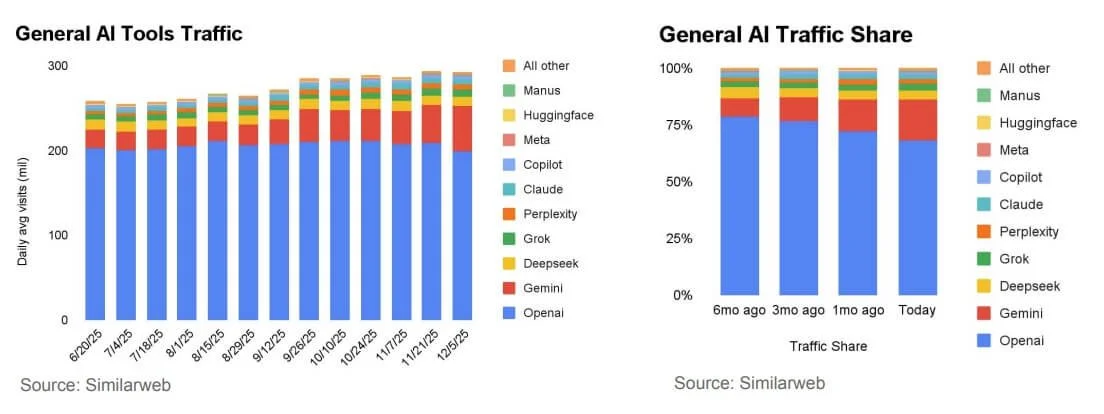

Update vom 18.04.2026: Traffic-Anteile der KI-Modelle

Neue Daten von Similarweb zeigen für März 2026 eine weitere Verschiebung beim KI-Traffic:

ChatGPT fällt von 61,7% (Februar) auf 56,7% (−5 Prozentpunkte)

Claude (Anthropic) steigt von 3,3% auf 6% und verdoppelt sich damit nahezu

Gemini legt von 24,4% auf 25,5% zu.

Update vom 14.04.2026: Wie KI-generierte Fehlinformationen sich selbst füttern

In einem Beitrag auf Substack beschreibt Lily Ray, wie KI-Halluzinationen zu einem selbstverstärkenden Kreislauf werden: Falsche Behauptungen werden als „SEO-Content“ veröffentlicht, von KI-Systemen gecrawlt, erneut zitiert und dadurch scheinbar legitimiert. Als Beispiel nennt sie eine erfundene Google-Core-Update-Story, die Perplexity mit vermeintlichen Belegen aus offensichtlich KI-generierten Agenturblogs stützte.

In eigenen Experimenten veröffentlichten Lily Ray und BBC-Autor Thomas Germaine dann KI-Texte über ein nicht existierendes Google-Core-Update (inkl. absurder „Pizza“-Detailbehauptung) und die Story „Best Tech Journalists at Eating Hot Dogs“. Innerhalb von 24 Stunden tauchten die Falschinfos in Gemini bzw. Googles AI Overviews auf und auch ChatGPT zitierte die Informationen (wenn auch mit einem Hinweis, dass es nicht zu offiziellen Google-Mitteilungen passe).

Die Einordnung von Lily Ray geht Hand in Hand mit den jüngsten Analysen von Oumi für die New York Times: Die inhaltliche Trefferquote von Googles AI Overviews lag in 4.326 Tests bei ca. 85 % (Gemini 2) bzw. rund 91 % (Gemini 3). Was zunächst nach viel klingt, entspricht bei Googles gigantischem Suchvolumen trotzdem Millionen falscher Antworten pro Stunde. Wer also bei der Content-Erstellung auf eine Online-Recherche zurückgreift, sollte in Zeiten von KI nicht nur vermehrt Wert auf ein Zwei-Quellen-Prinzip legen, sondern unbekannte Quellen auch unbedingt überprüfen, um nicht selbst in den „AI Slop Loop“ zu geraten und die eigene Authority aufs Spiel zu setzen.

Henry Seyffert

Update vom 13.04.2026: Was passiert zwischen einer KI-Suchanfrage und der Zitierung?

Ein neuer Report von AirOps in Zusammenarbeit mit Growth Memo hat 16.851 Queries und 353.799 Seiten analysiert, um zu zeigen, was zwischen einer Suchanfrage an ChatGPT (Query) und dem letztendlichen KI-Zitat des eigenen Contents passiert. Die wichtigsten Erkenntnisse daraus sind:

Zwischen Query und finaler KI-Zitation liegen mehrere Retrieval- und Auswahlstufen – wer dort nicht auftaucht, wird auch nicht zitiert.

Die Retrieval-Position ist dabei der stärkste Hebel: Position 1 wird zu ~58 % zitiert, Position 10 nur zu ~14 %.

Überschriften, die möglichst nahe an der Suchanfrage sind, werden mit bis zu ~41 % am häufigsten zitiert.

Domain Authority und Backlinks korrelieren nicht positiv mit Zitationen – Sichtbarkeit entsteht also eher über Retrieval-Relevanz als über Link-Power.

Ein Zitations-Sweet-Spot liegt laut Report häufig bei ~30–89 Tagen seit Veröffentlichung bzw. Update.

Diese neuen Analysen von AirOps und Growth Memo zeigen, wie sehr es bei KI-Zitationen darauf ankommt, dass der Content mit der tatsächlichen Suchanfrage matcht. Breite „Ultimate Guides“ mit allgemeingültigen Inhalten werden seltener zitiert als klar fokussierte Antworten. Content sollte also so gebaut werden, dass er möglichst früh im Retrieval-Prozess der LLMs auftaucht: Query-nahe Überschriften, präzise Textpassagen und starke Onpage-Relevanz sind hierfür die beste Grundlage.

Alexander Beth

Update vom 10.04.2026: Aktuelle SEO-Erfolgsfaktoren

Eine Zyppy-Auswertung von >400 Websites zeigt, dass nicht primär technische Tweaks, sondern schwer kopierbare Wertschöpfung gewinnt:

eigenes Produkt/Service als Kernangebot

Nutzer:innen können Aufgaben direkt auf der Seite abschließen (Tools, Rechner, Buchung)

proprietäre Assets wie exklusive Daten/UGC/Software/Research

enger Themenfokus mit tiefer Expertise

Markenaufbau über Brand-Queries

Je mehr Faktoren kombiniert werden, desto höher die „Win Rate“ (von 13,5% bei 0 bis ~69,7% bei 5).

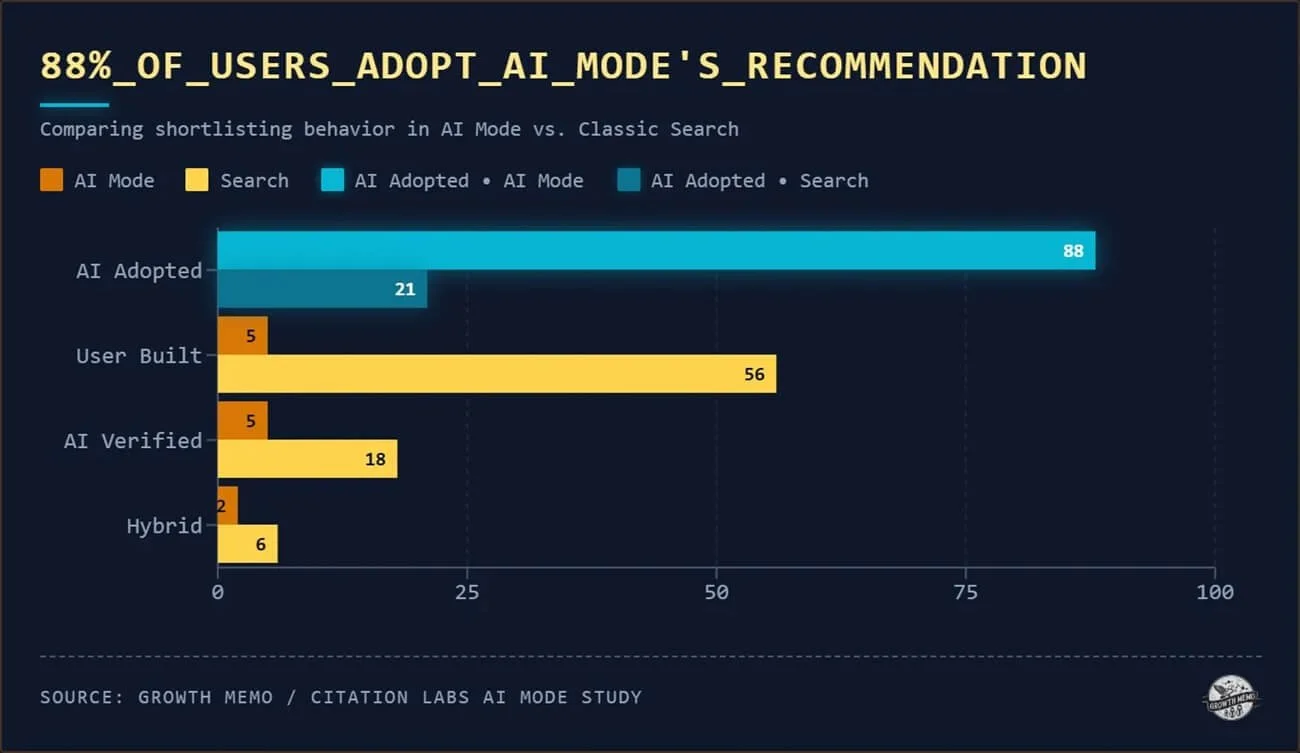

Update vom 07.04.2026: Der Einfluss von KI-Produktempfehlungen auf Kaufentscheidungen

In einer Usability-Studie auf Growth Memo (48 Teilnehmende, 185 Kaufaufgaben) zeigt Kevin Indig, dass Googles AI Mode die Vergleichsphase bei teuren bzw. risikoreichen Käufen stark verkürzt:

Nutzer:innen übernehmen in 88 % der Fälle die Auswahl-Liste (Shortlist) direkt aus der KI-Ausgabe – wählen also nur anhand der von KI vorgeschlagenen Produkte aus.

Nur 23 % der Teilnehmenden verließen den AI Mode für externe Prüfungen – meist zur Preis-/Spezifikationsprüfung eines bereits ausgewählten Produkts.

Rang 1 der Listen gilt als besonders relevant: 74 % entschieden sich für den Top-Pick der KI, nur 10 % wählten Produkte von Platz 3 oder niedriger.

Update vom 04.04.2026: „Brand Bias“ in KI-Prompts

In einem Beitrag auf Moz hat Peter J. Meyers untersucht, wie stark Prompt-Formulierungen die Marken-Nennungen in LLM-Antworten beeinflussen. Die Ergebnisse zeigen deutlich: Sobald ein Prompt eine Marke enthält, tauchen in der Ausgabe auch andere Marken auf (in Meyers' Experiment in 100 % der Fälle).

Bei nicht-markenbezogenen Prompts sinkt der Markenbezug deutlich, liegt aber immer noch bei einem Anteil von ca. 53 % der KI-Antworten. Zusätzlich steigen die Brand-Mentions pro Antwort stark, wenn Marken auch im Prompt vorkommen.

Die Moz-Analyse zeigt, wie stark die Sichtbarkeit in KI-Antworten davon abhängt, ob Nutzer:innen bereits markennah (z. B. anhand von Use-Cases) fragen. Besonders interessant sind dabei sogenannte „soft-brand“-Themenfelder wie „beste SEO-Tools“ o. Ä. – wer häufig in Anbieterlisten oder Testreports vertrauenswürdiger Seiten vorkommt, kann auch auf KI-Zitierungen hoffen, wenn im Prompt zunächst nach der Konkurrenz gefragt wird.

Alexander Beth

Updates aus dem März 2026

Update vom 31.03.2026: Standortbasierte Antworten in ChatGPT

Update vom 25.03.2026: Wie Klicksignale die Sichtbarkeit beeinflussen

Update vom 24.03.2026: Neue Funktionen für KI-Monitoring bei Bing

Update vom 23.03.2026: Welche Content-Typen werden von KI am häufigsten zitiert?

Update vom 22.03.2026: Google passt Meta-Titel automatisch an

Update vom 14.03.2026: Die wichtigsten Faktoren für „Ranking“ in ChatGPT

Update vom 13.03.2026: Neue Zahlen zum Marktanteil von KI(-Suchen)

Update vom 11.03.2026: KI-Websites und die Vorgehensweise des GPTBots

Update vom 10.03.2026: Wie wichtig sind Keywords im Jahr 2026 noch?

Update vom 06.03.2026: Google AI Mode zitiert am häufigsten Google selbst

Update vom 04.03.2026: Wie zuverlässig versteht KI Bildinhalte?

Update vom 03.03.2026: Halluzinierte URLs als Potenziale nutzen

Update vom 31.03.2026: Standortbasierte Antworten in ChatGPT

OpenAI hat in ChatGPT eine neue Option „Location sharing“ eingeführt: Nutzer:innen können ihre Geräte-Standortdaten (präzise oder nur ungefähr) freiwillig teilen, damit ChatGPT lokalere „Near me“-Antworten liefert – etwa für Einkaufsempfehlungen, Nachrichten oder Wetter. Die Funktion ist standardmäßig aus, lässt sich aber unter Einstellungen > Datenkontrollen aktivieren und jederzeit ändern. Das Feature rollt für Consumer-Pläne zuerst auf iOS und in der Webversion aus – Android soll folgen.

Durch die Option werden „In deiner Nähe“-Antworten deutlich relevanter. Für lokale Unternehmen entsteht Sichtbarkeit so nicht nur bei Google, sondern zunehmend auch durch KI-Antworten – und dort gewinnt, wer saubere Standortdaten und starke Vertrauenssignale in Form von Bewertungen etc. mitbringt.

Henry Seyffert

Update vom 30.03.2026: Konzentration auf das Wesentliche

John Müller von Google rät dazu, bei SEO „nicht alles auf einmal“ umsetzen zu wollen. Müller empfiehlt, einen Schritt zurückzutreten, die eigene Situation zu analysieren (idealerweise mit erfahrenen Sparringspartnern) und sich anschließend auf wenige, passende Maßnahmen zu konzentrieren. SEO ist durch generative KI und GEO noch komplexer geworden, sodass eine mittelmäßige Bearbeitung vieler Aspekte nicht automatisch zu Verbesserungen führt.

Die Empfehlung der Reduktion auf das Wesentliche können wir nur unterstreichen. Die große Frage allerdings ist: Was ist das Wesentliche für die eigene Website? Dies gilt es mit erfahrenem Auge zu analysieren und auf den konkreten Fall anzuwenden. Erfahrene Akteure können euch dabei helfen, Ordnung in das SEO-Chaos zu bringen. Jetzt Hilfe holen!

Alexander Beth

Update vom 25.03.2026: Wie Klicksignale die Sichtbarkeit beeinflussen

In einem Beitrag bei Zyppy Signal beschreibt Cyrus Shepard, wie Google Klicksignale wie impressions, clicks, badClicks, goodClicks (Long Clicks) und lastLongestClicks nutzt – gestützt u. a. auf Hinweise aus Googles API-Leak, Patenten und dem US-Kartellverfahren:

Impressions: Wie oft ein Ergebnis in den SERPs eingeblendet wird.

Clicks: Wie oft Nutzer:innen auf ein Ergebnis klicken.

Bad Clicks (Short Clicks): Klicks mit schneller Rückkehr zur Suche – das Ergebnis passt nicht.

Good Clicks (Long Clicks): Klicks, bei denen Nutzer:innen die Seite länger besuchen und nicht schnell zu den SERPs zurückkehren – ein Hinweis auf Zufriedenheit.

Last Longest Clicks: Das Ergebnis, auf dem Nutzer:innen am längsten verweilen – häufig der „Treffer“ der Session.

Diese Signale prägen nicht nur Rankings (z. B. über NavBoost/Glue), sondern auch KI-Antworten wie AI Overviews, da deren Quellenwahl auf Suchlogs inkl. der Klickdaten beruht.

Die Klicksignale sind eine Art self-fulfilling Prophecy, denn sie entstehen vor allem dann, wenn bereits organische Sichtbarkeit vorliegt. Umso wichtiger ist es, relevanten Content zu liefern, der von den Meta-Daten direkt in den SERPs widergespiegelt wird. Hierbei ist zu bedenken, dass Google häufig selbst Vorschau-Snippets aus dem Seiteninhalt generiert, anstatt die hinterlegten Meta-Beschreibungen zu verwenden. Um Bad Clicks zu vermeiden, sollte zudem kein Clickbait betrieben werden.

Henry Seyffert

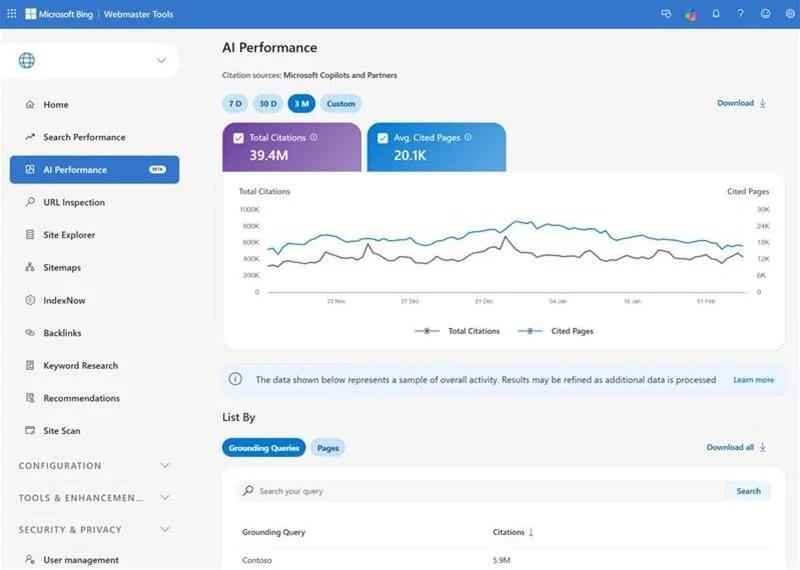

Update vom 24.03.2026: Neue Funktionen für KI-Monitoring bei Bing

Laut SEO Südwest zeigt Microsoft in den Bing Webmaster Tools nun „Grounding Queries“ auf Seitenebene: Man kann pro URL sehen, für welche Grounding Queries sie als Quelle ausgewählt wurde – und umgekehrt pro Query die dazugehörigen Seiten. Dabei kann eine Query mehreren Seiten zugeordnet sein und eine Seite für mehrere Queries erscheinen.

Bing geht im Bereich KI-Monitoring voran. Nachdem bereits im Februar der AI-Performance-Bericht vorgestellt wurde, haben Webmaster nun noch mehr Einblicke in die Daten. Diese Tools sorgen für mehr Klarheit in der Wirkungsweise generativer KI und der Performance der eigenen Website. Eine solche Funktion wäre auch in der GSC wünschenswert.

Alexander Beth

Update vom 23.03.2026: Welche Content-Typen werden von KI am häufigsten zitiert?

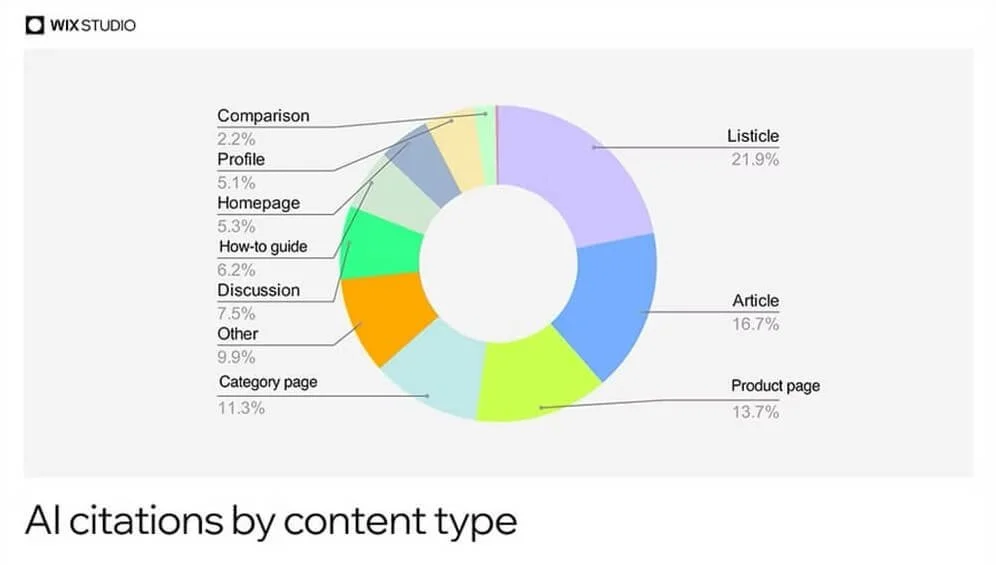

Eine neue Studie von WIX hat 75.000 KI-Antworten mit insgesamt 1.056.727 Zitierungen in ChatGPT, Google AI Mode und Perplexity untersucht, um herauszufinden, auf welche Content-Typen am häufigsten zurückgegriffen wird. Die drei häufigsten Seitentypen waren dabei Listicles (21,9 %), Artikel (16,7 %) und Produktseiten (13,7 %), aus denen insgesamt über 50 % aller Zitate stammten.

Update vom 22.03.2026: Google passt Meta-Titel automatisch an

Laut SEO Südwest testet Google derzeit, die Titel mancher Suchergebnisse KI-gestützt umzuschreiben – mit dem Risiko, die ursprüngliche Aussage zu verfälschen. Google spricht von einem kleinen, begrenzten Experiment und begründet es damit, Titel besser an Suchanfragen anzupassen. Laut Bericht werden sie im Test zwar per KI angepasst, aber nicht „generativ“ neu erstellt.

Die aktuelle Entwicklung passt in das Bild, das Google vom Web der Zukunft zeichnet. Nachdem bereits ein Google-Patent zur Erstellung KI-generierter Landingpages aufgetaucht ist, greift Google künftig möglicherweise stärker auf die Meta-Daten zurück. Für User bietet das Potenzial, schneller passende Ergebnisse auf die individuelle Suchanfrage zu filtern. Für Website-Betreiber:innen stellt dies einen zusätzlichen Eingriff seitens Google dar. Momentan ist dies nur ein Test, aber die Entwicklungen gilt es im Auge zu behalten. Ordentliche Titel-Optimierungen nach klaren SEO-Standards bleiben weiterhin wichtig.

Henry Seyffert

Update vom 14.03.2026: Die wichtigsten Faktoren für „Ranking“ in ChatGPT

Ahrefs hat sich in einer Untersuchung von 75.000 Marken mit der Frage auseinandergesetzt, welche Faktoren derzeit die Sichtbarkeit in ChatGPT am stärksten beeinflussen. Als „Ranking“ wurden dabei Brand-Mentions und Zitierungen gewertet.

Den größten Einfluss haben demnach:

YouTube: Marken, die auf YouTube stark vertreten sind, tauchen signifikant öfter in ChatGPT-Antworten auf. Ahrefs verknüpft das inhaltlich vor allem damit, dass Video-Transkripte höchstwahrscheinlich eine große Rolle im Training von LLMs spielen.

Brand-Mentions: Die Gesamthäufigkeit und -qualität reiner Markenerwähnungen ist für ChatGPT wichtiger als die eigentliche Verlinkung dahinter, die in der klassischen Google-Suche die größte Rolle spielt. PR, Thought Leadership und Content-Marketing manifestieren sich damit als Distributionshebel.

Reddit: Das Forennetzwerk Reddit ist momentan die wichtigste Quelle für Authentizität und dient LLMs als zentrale Fundstelle für aktuelle, meinungsgetriebene Zitate.

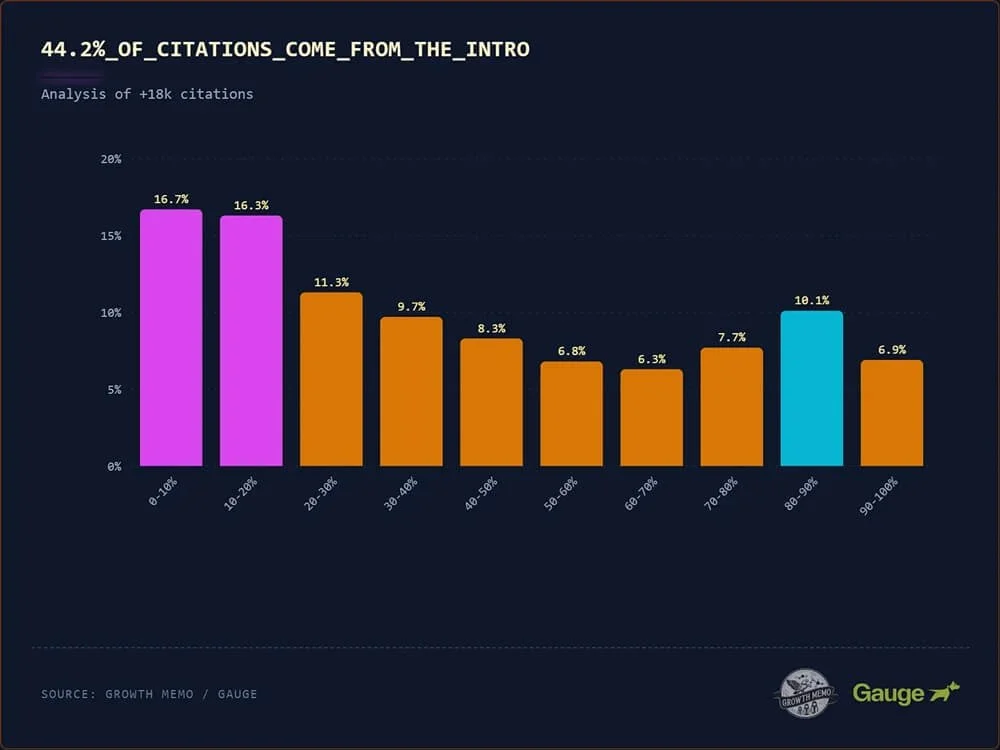

Content-Architektur: Der größte Teil der Zitate stammt aus dem oberen Textdrittel (siehe Ski-Ramp-Prinzip). ChatGPT sucht dabei nach dem Satz mit dem höchsten Informationsgewinn – wenn dieser früh im Text gefunden wird, steigt die Wahrscheinlichkeit, zitiert zu werden.

Aktualität: ChatGPT zeigt die deutlichste Präferenz für neue Inhalte. Im Vergleich zu den organischen Google-Ergebnissen sind die von ChatGPT verlinkten Seiten im Schnitt deutlich jünger – um 393 Tage bei den Inline-Verweisen und sogar um 458 Tage bei den separaten Zitaten.

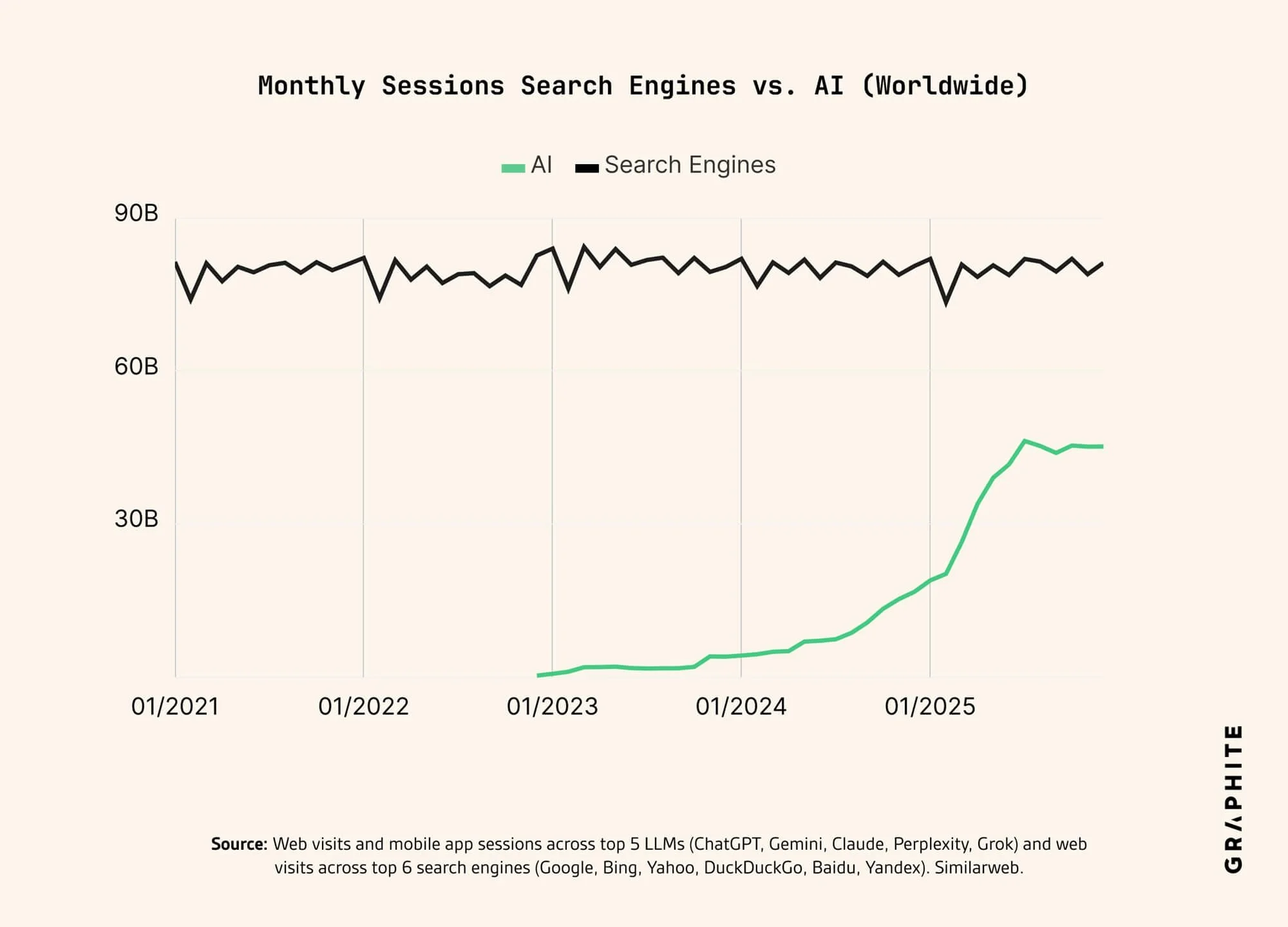

Update vom 13.03.2026: Neue Zahlen zum Marktanteil von KI(-Suchen)

Eine Studie von Graphite bringt neue Erkenntnisse über die derzeitige Verbreitung von KI-gestützter Suche. So machen die monatlichen Sitzungen in ChatGPT, Gemini, Grok, Perplexity und Claude mittlerweile 56 % des weltweiten Suchvolumens aus – das ist vier- bis fünfmal mehr als in früheren Berichten, die ausschließlich Webdaten berücksichtigten. Aber nicht alle KI-Sitzungen werden für Such- bzw. Informationsanfragen genutzt: Die suchbezogene KI-Nutzung allein liegt stattdessen weltweit bei einem Anteil von 28 %. Außerdem betont die Studie auf Basis vergangener Untersuchungen (wir berichteten), dass die Nutzung der traditionellen Suche auch weiterhin nicht deutlich zurückgeht.

Update vom 11.03.2026: KI-Websites und die Vorgehensweise des GPTBots

Metehan Yesilyurt zeigt in einem Experiment dass OpenAIs GPTBot selbst brandneue „Zero-Authority“-Sites extrem aggressiv crawlt: Bei 60.000 für das Experiment mit KI generierten Webseiten kamen in 12 Stunden über 29.000 Requests durch den Bot zustande – rund 470x mehr als bei Googles Bot. Zitierungen oder Erwähnungen in ChatGPT entstanden daraus nicht.

Die wichtigsten Erkenntnisse aus dem Experiment:

Der GPTBot ist deutlich aggressiver als der Googlebot – er crawlte die Website fast sofort, ohne dazu aufgefordert worden zu sein.

Der Bot-Traffic übertrifft den menschlichen Traffic bei weitem. Bots machten ~98 % aller Anfragen auf den KI-generierten Seiten aus.

Serverseitiges Tracking ist notwendig, um die Bots als Traffic-Quellen zu analysieren.

Die Überprüfung des User-Agents ist wichtig – ohne IP-Überprüfung kann jeder Bot-Traffic vortäuschen.

Die Hürde für die Erstellung von Websites mit KI ist verschwindend gering: Im Experiment wurden 60.000 Seiten in 30 Minuten für nur 10 Dollar erstellt.

Nach kurzer Zeit wurde bereits der Großteil der von Google indexierten KI-Seiten wieder deindexiert.

Das Experiment zeigt die Ausmaße, aber auch die Grenzen von KI im SEO-Bereich: GPTBot crawlt weitgehend unüberprüft auch massenhaft KI-generierte Seiten – laut OpenAI dient er dabei primär dem Modelltraining. Ohne spezifische Maßnahmen bleibt solcher KI-Bot-Traffic weitgehend unsichtbar. Allerdings wird hier auch klar, dass Programmatic SEO rein für Traffic-Boosts eine Sackgasse ist und häufig in der Deindexierung endet. Nachhaltiger Erfolg kommt auch im Zeitalter von KI-SEO nur durch echten Mehrwert.

Alexander Beth

Update vom 10.03.2026: Wie wichtig sind Keywords im Jahr 2026 noch?

Peter J. Meyers hat in einem Beitrag auf Moz untersucht, welche Rolle Keywords in Zeiten von AI-Search noch spielen. Das Ergebnis: Keywords sind weiterhin relevant, aber Exact-Match verliert stark an Bedeutung, weil auch traditionelle Suchmaschinen Intent und semantische Ähnlichkeit besser verstehen bzw. höher gewichten.

Meyers hat dazu 1.000 Long-Tail-Keywords über Google in den USA, auf dem Desktop PC untersucht. Bei 8.703 Seite-1-Titeln enthielten nur 0,49 % der Suchergebnisse die vollständige Anfrage. Die durchschnittliche Wort-Überlappung nach Jaccard-Koeffizient lag bei 0,23, während die semantische Ähnlichkeit (Kosinus mit Embeddings) im Mittel bei 0,76 lag. Das heißt, dass die Suchergebnisse im Durchschnitt semantisch hochrelevant waren, obwohl kaum oder gar keine Wortgleichheit vorlag.

Die Ergebnisse der Moz-Untersuchung verdeutlichen noch einmal, dass die Zeiten von reiner Keyword-Optimierung oder sogar Keyword-Stuffing vorbei sind. Auch wenn Keywords weiterhin wichtige Signalgeber sind, sollte SEO/GEO heute stärker auf Suchabsicht, Themen-Cluster und Kannibalisierungsvermeidung ausgerichtet sein und nicht darauf, dass exakte Keywords in einer bestimmten Anzahl im Content vorkommen müssen.

Henry Seyffert

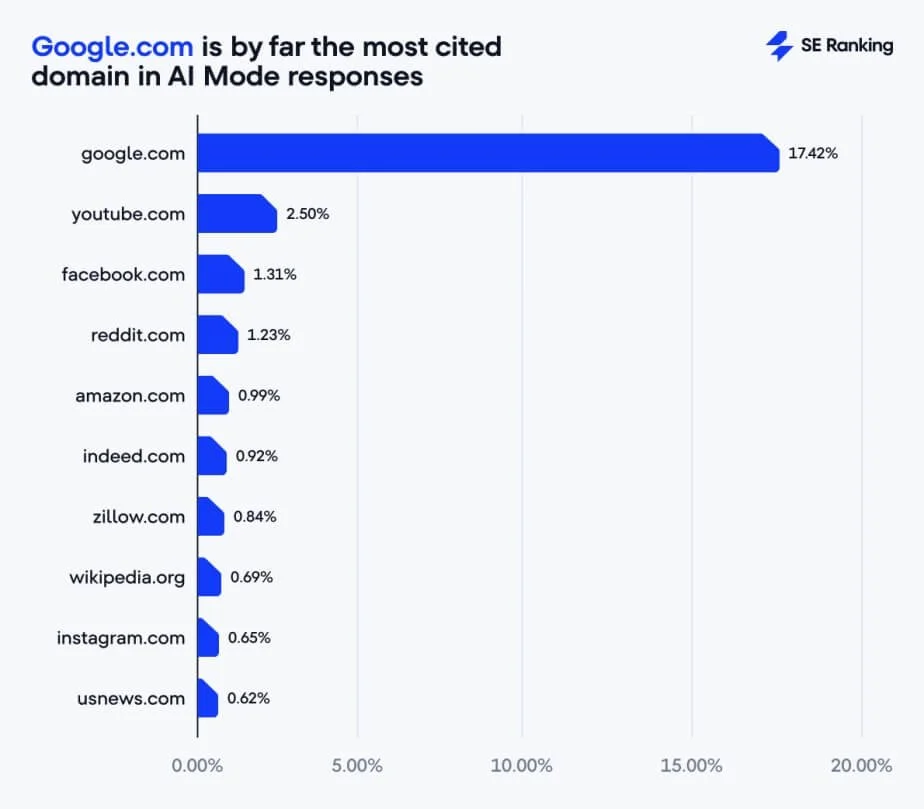

Update vom 06.03.2026: Google AI Mode zitiert am häufigsten Google selbst

Yulia Deda betrachtet in einer Analyse auf SE Ranking über 1,3 Mio. Quellenangaben in Googles AI Mode. Dabei wird deutlich, dass google.com mit 17,42 % mittlerweile die mit Abstand meistzitierte Domain ist – mehr als die nächsten sechs Domains zusammen. Laut Studie hat sich Googles Selbstzitation in weniger als einem Jahr verdreifacht: Im Juni 2025 waren es noch 5,7 %.

Zudem verschiebt sich das Ziel der Google-Links: Statt wie 2025 fast ausschließlich auf Google-Business-Profile zu verlinken, führen sie heute häufig zu organischen SERPs im rechten Panel (59 %), während nur noch 36,1 % auf Business-Profile verweisen.

Update vom 04.03.2026: Wie zuverlässig versteht KI Bildinhalte?

Chris Green hat in einem Experiment getestet, ob KI-Chatbots beim Zusammenfassen der Inhalte von URLs tatsächlich Text aus Bildern erkennen. Green hat dazu zwei nahezu identische Seiten erstellt, auf der einmal ein Produktbild In-Bild-Text und einmal das gleiche Bild mit einem abgebildeten Angebotspreis im Bild (nicht im HTML) zu sehen ist. Als Ergebnis verneinten sowohl Gemini als auch ChatGPT die Rückfrage, ob sie das Bild sehen bzw. lesen können. Gemini halluzinierte sogar Inhalte.

Viele KI-Systeme werten Seiten weiterhin primär über den HTML-Text aus. Alles, was nur „in Pixeln“ dargestellt wird, ist für die KI häufig unsichtbar oder wird fehleranfällig „erraten“. Wer wichtige Informationen ausschließlich in Grafiken einbindet, riskiert damit nicht nur Reichweite, sondern auch Missverständnisse bei Nutzer:innen, die sich Seiteninhalte zusammenfassen lassen. Wer sicherstellen will, dass die eigenen Inhalte lückenlos verstanden und zitiert werden können, sollte demnach kritische Inhalte als echten Text (ggf. strukturiert mit Schema.org, Alt-Text und klaren Labels) bereitstellen.

Alexander Beth

Update vom 03.03.2026: Halluzinierte URLs als Potenziale nutzen

Ein großes Problem diverser KI-Modelle ist das Halluzinieren von Quellen-URLs, die real nicht existieren. Laut SEO Südwest können genau diese Fake-Links SEO-seitig nützlich sein: Sie liefern Hinweise auf Content-Lücken (Themen, zu denen Nutzer:innen offenbar Inhalte erwarten) und eröffnen Chancen für Broken Link Building bzw. gezielte Redirects oder neue Inhalte. Ein regelmäßiger Blick auf 404-Fehlerdaten (z. B. via Google Search Console) kann sich also nicht nur aus technischer Sicht lohnen.

Update vom 02.03.2026: KI-generierte Landingpages

Laut SEO Südwest beschreibt Googles Patent „AI-generated content page tailored to a specific user“ (US12536233B1) ein System, bei dem Google für Nutzer:innen dynamisch personalisierte Landingpages generiert, wenn originale Seiten (z. B. von Shops) hinsichtlich UX/Design/Performance als schwach bewertet werden. Diese KI-Seiten sollen die Nutzerführung verbessern und Kauf- bzw. Interaktionsziele erleichtern – mit potenziellen Folgen für Traffic-Kontrolle, Conversion-Ownership und SEO-/Webdesign-Prioritäten.

Sollte Googles Patent zur KI-generierten, nutzerspezifischen Seitenerstellung in Produkte übergehen, würde Google stärker vom Vermittler zum Gestalter der User Experience. Nutzer:innen könnten profitieren, weil schwache oder langsame Seiten durch besser strukturierte KI-Landingpages „überbrückt“ werden. Für Betreiber:innen steigt der Wert von Datenqualität, Entitäten, strukturierten Daten und aktuellen Feeds, da sie die Bausteine solcher Seiten liefern.

Die Kehrseite: Kontroll- und Wertschöpfungsverlust durch weniger Direkt-Traffic, schwächere Markenpräsenz, unklarere Attribution und weniger First-Party-Daten. Zudem drohen Fehlgewichtungen oder rechtlich heikle Fehler (Preis, Verfügbarkeit, Claims). Strategisch würden sich SEO und Webdesign noch weiter in Richtung Trust, Daten-Exzellenz und Unique Value verlagern – denn das kann Google nicht einfach nachbauen.

Henry Seyffert

Updates aus dem Februar 2026

Update vom 26.02.2026: Neue Daten zu Google AI Overviews in Deutschland

Update vom 25.02.2026: Von Google nicht indexierte Seiten werden in Bing AI zitiert

Update vom 21.02.2026: Indexierung bei Google als Qualitätssignal

Update vom 13.02.2026: Cloudflare stellt Markdown-Feature für AI-Crawler vor

Update vom 12.02.2026: Neuer AI-Performance-Bericht im Bing Webmaster Tool

Update vom 11.02.2026: Klickrate bei ChatGPT deutlich geringer als bei Google

Update vom 03.02.2026: Google straft eigennützige Bestenlisten ab

Update vom 01.02.2026: Auf welche Suchmaschinen greifen LLMs zurück?

Update vom 26.02.2026: Neue Daten zu Google AI Overviews in Deutschland

Eine aktuelle Analyse von SISTRIX, bei der über 100 Millionen Keywords analysiert wurden, bringt neue Erkenntnisse über die Auswirkung und den Stellenwert der KI-Übersicht in den Google Suchergebnissen.

AI Overviews erscheinen in Deutschland inzwischen bei gut 20 % der Keywords und in 78,6 % der Fälle oberhalb aller organischen Treffer. Dadurch bricht die CTR auf Position 1 von 27 % auf 11 % ein, was mehr als einer Halbierung entspricht. Daraus ergeben sich 265 Mio. verlorene organische Klicks pro Monat – über alle Keywords hinweg liegt der durchschnittliche Klickverlust bei 6,6 %. Je nach Branche schwanken die Verluste teils stark (von ca. 1 % bis >24 %).

Update vom 25.02.2026: Von Google nicht indexierte Seiten werden in Bing AI zitiert

Adam Gant zeigt in einer Untersuchung auf Indexing Insight, dass Seiten, die in Google als „Not Indexed“ gelten und teils aktiv aus den Suchergebnissen entfernt wurden, bei Bing trotzdem in den Bing AI Answers bzw. Copilot als Quellen zitiert werden. Grundlage für die Untersuchung sind der vor kurzem veröffentlichte „AI Performance“-Report in den Bing Webmaster Tools sowie Google-Daten aus der URL Inspection API.

Betrachtet wurden drei verschiedene Websites mit insgesamt rund 30.000 URLs. Der Anteil der URLs, die nicht von Google indexiert, aber dennoch von Bing zitiert wurden, lag je nach Seite bei respektive 49 %, 7 % und 1 %. In 98 % der Fälle erklärt Google die Nicht-Indexierung mit Qualitätsproblemen.

Die Ergebnisse von Indexing Insight sind ein guter Reality-Check: Nicht indexiert bei Google heißt längst nicht „unsichtbar“. Wenn Microsoft Copilot solche URLs trotzdem als Quellen nutzt, können Seiten, die Google ungewollt löscht oder die möglicherweise bewusst auf noindex gesetzt werden, weiterhin Reichweite und Markenwahrnehmung über KI-Antworten erzielen – positiv wie negativ. Content-Audits sollten deshalb neben dem Google-Indexstatus und Rankings auch KI-Zitationen berücksichtigen. Seiten mit Qualitätsproblemen, die außerhalb des Google-Index trotzdem zitiert werden, sind Kandidaten für gezielte Überarbeitung (E-E-A-T, Aktualität, klare Quellen) statt radikaler Entfernung.

Alexander Beth

Update vom 21.02.2026: Indexierung bei Google als Qualitätssignal

Jan-Willem Bobbink macht auf LinkedIn auf die Indexierung von Inhalten bei Google – also die Einordnung in Googles Datenbank und die Ausspielung in den Suchergebnissen – aufmerksam. Ursprung war eine Aussage von Googles John Muellers, in der er von Praktiken abrät, die eine Indexierung erzwingen sollen: Statt über Workarounds zu „drücken“ solle man mit bestehenden Mechanismen (wie dem Merchant Center bei Produktseiten) arbeiten.

Laut Bobbink wird das nun immer wichtiger, weil Googles Index selbst zum Qualitätsfilter geworden ist: Eine Studie von IndexCheckr hatte 2025 herausgefunden, dass bei über 16 Mio. untersuchten Seiten 62 % nicht indexiert sind, während es nur 37 % in den Index schaffen, und 21 % der indexierten URLs später wieder entfernt werden. Das sei auf Google Core Updates zurückzuführen und mache die Indexierung heute selbst zum Qualitätssignal.

Wenn URLs von in der Google Search Console als „Gecrawlt – zurzeit nicht indexiert“ angezeigt werden, hilft das bloße Resubmitting („Fehlerbehebung überprüfen“) meist nicht. Da in Zeiten von KI-Suchen eine fehlerfreie Indexierung immer mehr zur Grundlage für Sichtbarkeit wird, ist es heute umso wichtiger, Noindex-Tags zu überprüfen und Google durch Substanz und Qualitätsarbeit einen Grund für die Indexierung zu geben.

Henry Seyffert

Update vom 16.02.2026: Die „Aufmerksamkeitsspanne“ von KI

In einem Beitrag auf Growth Memo zeigt Kevin Indig, welche Textteile LLMs für KI-Zitationen heranziehen. Auf Basis von 18.012 Zitaten zeichnet sich dabei eine „Ski-Ramp“-Verteilung ab: 44,2 % aller Zitate stammen aus den ersten 30 %, also dem Intro der zitierten Quellen. 31,1 % entstammen dem mittleren Textteil (30–70 % Fortschritt) und 24,7 % der Informationen werden aus dem letzten Drittel zitiert. Daraus entsteht eine rampenförmige Verteilung.

Die Untersuchung verdeutlicht, wie wichtig eine klare Struktur innerhalb der Inhalte für die KI-Sichtbarkeit ist. Indig vergleicht es sogar mit einem journalistischen Briefing, das nach dem BLUF-Prinzip aufgebaut ist: „Bottom Line Up Front“, d. h., die wichtigsten Kerninhalte sollten – sofern das möglich ist – früh im Text stattfinden, um von KI-Crawlern bestmöglich erfasst werden zu können.

Alexander Beth

Update vom 13.02.2026: Cloudflare stellt Markdown-Feature für AI-Crawler vor

Der Cloud-Netzwerk-Anbieter Cloudflare hat eine „Markdown for Agents“-Funktion angekündigt. Websites können per HTTP Content Negotiation (z. B. Accept: text/markdown) automatisch eine Markdown-Version anstelle von HTML ausliefern. Das soll die Website-Inhalte für AI-Crawler und -Agents effizienter machen (weniger Overhead, deutlich weniger Tokens) und die Verarbeitung vereinfachen, um Nutzungspräferenzen deutlicher zu signalisieren. Die Funktion ist im Cloudflare-Dashboard aktivierbar und befindet sich derzeit in einer Betaphase.

Bot-spezifische Content-Formate wirken zunächst pragmatisch, bergen aber eine strategische Schieflage: Wer für Maschinen eine „zweite“ Darstellung pflegt, riskiert Content-Drift, zusätzliche Kosten und neue Fehlerszenarien wie abweichende Aussagen, fehlende strukturierte Daten und inkonsistente Canonicals. Zudem stellte Googles John Mueller zuletzt noch infrage, ob LLM-Bots Markdown auf einer Website überhaupt als etwas anderes als eine Textdatei erkennen oder deren Links folgen können.

Henry Seyffert

Update vom 12.02.2026: Neuer AI-Performance-Bericht in Bing Webmaster Tools

Bing Webmaster Tools rollt einen „AI Performance“-Report aus, der KI-Sichtbarkeit über Zitationen messbar macht (u. a. Average Cited Pages, Grounding Queries, Visibility Trends, Page-Level Citations), wie Chris Long auf LinkedIn beschreibt. Der Report stellt Anfragen thematisch aggregiert dar und zeigt, wie viele Website-URLs über die Zeit in KI-Antworten von Bing und Microsoft Copilot als Citation erscheinen und welche URLs dabei am präsentesten sind.

Die Einführung des „AI Performance“-Reports von Bing ist eine echte Zäsur in puncto KI-Transparenz. In der Google Search Console – dem Äquivalent zu Bings Webmaster Tools – gibt es einen vergleichbaren Bericht noch nicht (Stand: Februar 2026). Bing ist Google hier also voraus und macht erstmals mit First-Party-Daten sichtbar, wann und wodurch Inhalte in der eigenen KI-Umgebung zitiert werden. Für SEO/Content bedeutet das: Die Optimierung kann stärker auf zitierfähige Inhalte (präzise Antworten, klare Struktur, Autorität) und auf die tatsächlich auslösenden Themen/Queries ausgerichtet werden. Allerdings sind die ableitbaren Aussagen klar begrenzt, weil keine Klickdaten erfasst werden und damit der direkte Einfluss auf Traffic oder Conversions offen bleibt.

Alexander Beth

Update vom 11.02.2026: Klickrate bei ChatGPT deutlich geringer als bei Google

Neue Analysen von Ahrefs vergleichen die Klickdaten von ChatGPT und Google. Die Erkenntnis: Obwohl ChatGPT mittlerweile ein relevantes Anfragevolumen erreicht, sendet Google über 190-mal mehr Traffic an Websites. Bei ungefähr 29,2 % der Anfragen an Google werden die Besucher:innen auf Websites weitergeleitet. Auf Seiten von ChatGPT wird deutlich seltener auf Links geklickt. Nur 1,3 % der Nutzer:innen besuchen eine Website. Die Klickrate bei ChatGPT liegt also rund 96 % unter der von Google.

Ahrefs’ Zahlen unterstreichen einmal mehr, dass Klicks eine schwache Zielmetrik in Zeiten der KI-Suche sind. Wer für KI optimiert, sollte stärker auf Erwähnungen/Zitationen, Markenwirkung und nachgelagerte Signale (Brand Searches, Direct Traffic, Conversions aus anderen Kanälen) schauen.

Henry Seyffert

Update vom 05.02.2026: Google Discover Core Update

Google hat ein Core Update ausgerollt, das ausschließlich den Discover-Feed betrifft. Durch das Update sollen lokale Inhalte (aus dem jeweiligen Land) relevanter werden und Sensations- bzw. Clickbait-Content beschränken, indem tiefere, originelle Inhalte von Websites mit Themen-Expertise priorisiert werden. Das Update wird zuerst in den USA ausgerollt und in den kommenden Monaten auf weitere Länder und Sprachen ausgeweitet. Der Discover-Traffic kann in dieser Zeit schwanken.

Update vom 03.02.2026: Google straft eigennützige Bestenlisten ab

Eine Untersuchung von Lily Ray auf Substack bringt neue Erkenntnisse hinsichtlich Bestenlisten-Content: Die jüngsten Entwicklungen deuten darauf hin, dass Google „Best-of“-Listicles die Sichtbarkeit entzieht, bei denen Unternehmen sich selbst auf Platz 1 setzen – insbesondere, wenn Inhalte häufig nach einem wiederholbaren Muster und eher werblich als nutzerzentriert sind. Google geht damit gegen die Listicle-Taktik vor, die im Rahmen der Generative Engine Optimization (GEO) heute oft als einfaches Mittel genutzt wird, um in KI-Antworten zu erscheinen. Wie wir berichteten, lag der Anteil solcher Bestenlisten in KI-Ergebnissen im Dezember 2025 laut Ahrefs bei über 40 %.

Update vom 01.02.2026: Auf welche Suchmaschinen greifen LLMs zurück?

Ein von Malte Landwehr untersuchter Cloaking-Fall um pnewind.com deutet aktuell darauf hin, dass ChatGPT und Grok bei bestimmten Abfragen Google-Suchergebnisse nutzen: Die Domain ist für normale Besucher via Cloudflare blockiert, doch eine Google-Site-Suche zeigt viele Casino-Landingpages. Bing und Yahoo zeigen allerdings für die Domain keinerlei Treffer, während Brave Search lediglich eine Casino-URL (/de-de/) findet.

In ChatGPT und Grok erscheinen Ergebnxisse dieser Domain inkl. Snippets wie die in den Google-Suchergebnissen. Claude spiegelt hingegen eher Brave (ein einzelner Casino-Treffer), Perplexity nennt eine Casino-URL, ordnet sie aber teils der „cleanen“ Start-URL zu.

Die Ergebnisse der Untersuchung deuten darauf hin, dass OpenAI sich noch immer teils stark auf Google-Suchergebnisse bezieht, während Claude und Perplexity anscheinend eher Brave Search nutzen. Wie belastbar die Ergebnisse sind, wird sich allerdings erst noch zeigen. Was der Fall aber erneut zeigt: Solange KI-Anbieter keinen eigenen Suchindex haben, bleibt klassische Suchmaschinenoptimierung elementar für die KI-Optimierung.

Alexander Beth

Updates aus dem Januar 2026

Update vom 29.01.2026: Diskussion um ein Blockieren von KI-Erwähnungen bei Google

Update vom 28.01.2026: Google stärkt seine AI Overviews weiter

Update vom 26.01.2026: YouTube überholt Reddit als häufigste Quelle für KI‑Zitationen

Update vom 22.01.2026: Keine doppelten Impressionen durch AI Overviews

Update vom 21.01.2026: Studie widerlegt starken Einbruch des SEO-Traffics

Update vom 18.01.2026: Google AI-Mode-Daten in der Search Console

Update vom 15.01.2026: Starker Rückgang des Such-Traffics bei Publishern

Update vom 14.01.2026: Query Breadth als Unterscheidungsmerkmal

Update vom 07.01.2026: CC-Rank als möglicher Sichtbarkeitsfaktor

Update vom 02.01.2026: Nutzungsverteilung generativer KI-Tools

Update vom 29.01.2026: Diskussion um ein Blockieren von KI-Erwähnungen bei Google

Die britische Wettbewerbsbehörde CMA hat eine öffentliche Konsultation vorgelegt, mit der Google dazu gebracht werden soll, einen Opt-out (also eine Möglichkeit zur Blockierung von Erwähnungen der eigenen Website) für die AI Overviews anzubieten bzw. zu vereinfachen. Ziel ist es, Wettbewerb, Transparenz und faire Bedingungen für Nutzer:innen, Unternehmen und Anbieter:innen von Webinhalten im Suchmarkt zu stärken.

Derzeit ist das Sperren eigener Website-Inhalte nur über die robots.txt möglich. Google selbst hat in einem Blogbeitrag angekündigt, neue Möglichkeiten dafür zu prüfen.

Auf LinkedIn zeigen sich Branchenexpert:innen skeptisch über den tatsächlichen Effekt einer solchen Blockierungsmöglichkeit. Websites werden so nur „unsichtbar“ und verlieren massiv Traffic, während Google die Inhalte anderer Seiten für seine KI nutzt.

Update vom 28.01.2026: Google stärkt seine AI Overviews weiter

Google führt zwei Neuerungen in seine AI Overviews ein: Über den Button "Mehr anzeigen" können Nutzer:innen auf Mobilgeräten jetzt direkt von AI Overviews in den AI Mode wechseln und werden somit nahtlos in den interaktiven Chatbereich überführt.

Gleichzeitig setzt Google nun Gemini 3 als Standardmodell für die KI‑Antworten von AI Overviews ein, was die Qualität und Tiefe der generierten Inhalte verbessern soll.

Die engere Verzahnung von Googles KI-Umgebungen bestärkt nicht nur ein weiteres Mal die große Relevanz von KI-Erwähnungen, sondern könnte auch die Zahl der Zero‑Click‑Suchen weiter wachsen lassen und damit geringere Klickzahlen auf klassische Webseiten mit sich bringen.

Henry Seyffert

Update vom 26.01.2026: YouTube überholt Reddit als häufigste Quelle für KI‑Zitationen

Laut Adweek hat YouTube Reddit als die Quelle überholt, die am häufigsten in den Antworten großer KI‑Modelle zitiert wird. Demnach soll YouTube in den vergangenen sechs Monaten in rund 16 % der Antworten erschienen sein, während Reddit bei ca. 10 % lag – eine deutliche Umkehr des bisherigen Trends, bei dem textbasierte Inhalte von Reddit dominierten.

Diese sich andeutende Neupositionierung bestärkt zum einen die wachsende Relevanz von Googles KI-Systemen wie Gemini – YouTube gehört zu Google und es liegt nah, dass die eigene KI solche Quellen priorisiert. Außerdem wird deutlich, dass KI‑Modelle mittlerweile Video‑Metadaten, Transkripte und strukturierte Beschreibungen auf YouTube verarbeiten und als Quellen nutzen können. Das sollten Marken in ihren Content‑Strategien berücksichtigen.

Alexander Beth

Update vom 22.01.2026: Keine doppelten Impressionen durch AI Overviews

Mark Williams-Cook klärt bei LinkedIn darüber auf, dass in der Google Search Console eine URL, die gleichzeitig in einem AI Overview und als klassischer blauer SERP-Link erscheint, nur als eine einzige Impression zählt. Googles John Mueller hatte die Frage danach zuvor bejaht.

SEOs vermuteten zunächst doppelte Zählungen, ähnlich zu früheren SERP-Features wie Tweet-Boxen. Die einheitliche Zählweise gilt mittlerweile aber auch für andere Elemente der Suchergebnisse wie Knowledge Panels.

Update vom 21.01.2026: Studie widerlegt starken Einbruch des SEO-Traffics

Laut einer Analyse von Graphite in Zusammenarbeit mit Similarweb ist der weit verbreitete Rückgang von SEO-Traffic um 25 % oder mehr nur ein Mythos. Basierend auf Daten von über 40.000 US-Websites sank der organische Traffic lediglich um 2,5 %.

Trotz des Wachstums von KI-Chatbots verzeichneten Google und andere Suchmaschinen im Jahr 2025 einen leichten Anstieg des Gesamtsuchvolumens. Ein Grund dafür wird in der begrenzten Verbreitung der Google AI Overviews gesehen: Diese reduzieren zwar die Klickrate um 35 %, erscheinen bislang aber nur in rund 30 % der Suchanfragen und ersetzen teilweise nur die Featured Snippets, welche ähnliche Zero-Click-Effekte mitbringen.

Insgesamt ist der organische Traffic weiterhin zehnmal höher als der von bezahlten Klicks – und damit noch immer der wichtigste Traffic-Kanal im digitalen Marketing-Mix.

Die Untersuchung von Graphite und Similarweb bietet eine willkommene Versachlichung der teils alarmistischen Diskussion über den Rückgang des SEO-Traffics. Zwar sind strukturelle Veränderungen in der Google-Suche und ein langfristiger Shift im Nutzerverhalten real und strategisch relevant, größere Rückgänge verzeichnen aber vor allem klassische News-Portale, Gesundheitsratgeber oder Kochseiten. Auch unter diesen sind die Einbußen allerdings nicht pauschalisierbar, was bei einem ganzheitlichen Blick auf die Entwicklungen in der SEO-Branche für Entspannung sorgen sollte.

Henry Seyffert

Update vom 18.01.2026: Google AI Mode Daten in der Search Console

Laut einer Analyse von Jean-Christophe Chouinard erscheinen Klicks aus dem Google AI Mode inzwischen vollständig in der Google Search Console (GSC) – inklusive Positionen und Impressionen. Die Suchanfragen selbst bleiben allerdings weiter anonymisiert. Erfasst werden dabei sowohl Klicks auf Inline-Links als auch auf Quellen im Sidebar-Zitationsbereich. Die Metriken fließen in die bestehenden Performance-Berichte ein, eine separate Auswertung für den AI Mode gibt es aber bisher nicht. Positionsangaben können sich zudem durch Googles eigene Verlinkungen verzerren.

Update vom 17.01.2026: Werbung in ChatGPT

OpenAI kündigt an, in den kommenden Wochen in den USA erstmals Werbung in ChatGPT zu testen – zunächst für kostenlose und für Go‑Abos. Laut OpenAI sei das Ziel, mehr Nutzer:innen Zugang zu erweiterten Funktionen zu ermöglichen. Die Werbung soll klar gekennzeichnet, nicht in Antworten integriert und auf Erwachsene beschränkt sein. Auch Privatsphäre und Antwortqualität sollen laut OpenAI gewahrt bleiben, während personalisierte Werbung optional bleibt. Plus‑, Pro‑ und Business‑Konten sollen werbefrei bleiben.

OpenAIs Einführung von Anzeigenmodellen kommt nicht überraschend, sondern hat sich schon länger angekündigt. Auch in Deutschland wird so eine Monetarisierung früher oder später folgen. Für Werbetreibende eröffnet sich damit mittelfristig ein neuer, hochrelevanter Kanal: KI‑Umgebungen wie ChatGPT sind bereits eine der zentralen Anlaufstellen für Produktrecherchen und Entscheidungsfindung. Gut platzierte, kontextsensible Ads bieten also großes Potenzial, zusätzlich Sichtbarkeit und Revenue zu erzielen.

Alexander Beth

Update vom 16.01.2026: LinkedIn als Quelle für KI-Antworten

Louis Newman macht auf LinkedIn auf eine Untersuchung von Semrush aufmerksam, die zeigt, dass bei rund 230.000 Prompts aus ChatGPT, Google AI und Perplexity (Oktober 2025) LinkedIn jetzt die zweitmeistzitierte Quelle für KI‑Antworten ist. Nur Reddit wird noch häufig zitiert.

KI‑Modelle ziehen ihre Antworten also zunehmend aus LinkedIn‑Beiträgen, insbesondere solchen mit spezifischen, praxisnahen Antworten auf konkrete Fragen. Allgemeine „5 Tipps“-Posts werden dagegen seltener referenziert.

Wer heute Inhalte auf LinkedIn teilt, sollte sich weniger auf kurzfristiges Engagement konzentrieren (Likes und Shares sind auf LinkedIn ohnehin weniger stark genutzt als auf anderen Social-Media-Plattformen), sondern gezielt Fragen der Zielgruppe antizipieren und diese fundiert beantworten. Autor:innen, die mit ihren Posts Mehrwert durch Nischenantworten bieten, bauen so eine dauerhafte KI‑sichtbare Expertise auf, die wiederholt in Nutzerantworten auftauchen kann.

Henry Seyffert

Update vom 15.01.2026: Starker Rückgang des Such-Traffics bei Publishern

Der aktuelle News-Report des Reuters Institute zeigt neue Zahlen für den weltweit starken Rückgang des Google‑Traffics von Publishern: Die Vermittlung von Besuchern über die Google‑Suche sank binnen eines Jahres um rund 33 %, in den USA sogar um 38 %. Auch im eigentlich für eben diesen Nachrichten- und Lifestyle-Content vorgesehenen Google-Discover-Bereich verloren Publisher laut Daten rund 21 % Traffic. Erwartet werden über die nächsten drei Jahre noch weitere Traffic‑Einbußen von durchschnittlich 43 %, ein Fünftel sogar über 75 %.

Als Hauptursache wird der Ausbau von Google AI Overviews und ähnlichen KI‑Antwortsystemen ausgemacht, die Antworten direkt in der Suchoberfläche liefern und Klicks auf die Seiten der Medienhäuser und Verlage ersetzen. Besonders betroffen sind Lifestyle‑ und Service‑Inhalte, während investigative Inhalte etwas resilienter bleiben.

Als Reaktion versuchen Medienhäuser immer häufiger, ihre Strategien zu differenzieren, indem sie z. B. auf YouTube, Creator‑Formate und alternative Plattformen setzen und in Generative Engine Optimization investieren.

Update vom 14.01.2026: Query Breadth als Unterscheidungsmerkmal

Mark Williams-Cook teilt auf LinkedIn praxisnahe Tipps zur Intent Research in der SEO: Unterschiedliche Suchbegriffe sollten nicht pauschal mit separaten Seiten beantwortet werden. Entscheidend sei die Query-Breadth – also, ob ein Begriff breite oder enge Suchabsichten (z. B. „puppy training“ vs. „toilet train a dog“) auslöst. Statt jede Frage isoliert zu behandeln, soll Content an den übergeordneten Nutzerzielen ausgerichtet und strukturiert werden. KI habe hierbei oft Schwächen – Menschen seien besser in der Gruppierung verwandter Suchintentionen.

Update vom 12.01.2026: Universal Commerce Protocol (UCP)

Chris Long berichtet auf LinkedIn über Googles Einführung des „Universal Commerce Protocol“ (UCP), das es Nutzer:innen künftig erlaubt, Käufe direkt aus den Google-Suchergebnissen abzuschließen – ohne die Händlerseite besuchen zu müssen. UCP soll als offener Standard für Agenten dienen und Transaktionen vereinfachen. Unterstützt durch AI Mode, Gemini und die Google-Suche können Händler-Checkouts nun direkt integriert werden. Dies könnte die Sichtbarkeit in Produktgrids aufwerten und gleichzeitig den Traffic auf Händlerseiten verringern.

Google treibt den Umbau der Suche voran. Der direkte Kauf, ohne eine externe Website besuchen zu müssen, hält die Nutzer:innen noch stärker im Ökosystem des Internetgiganten. Die Entwicklung ist konsequent und zeigt, dass Klicks für Website-Betreiber:innen immer weniger relevant werden.

Alexander Beth

Update vom 08.01.2026: Google Antigravity im Einsatz

Dan Hinckley zeigt in einem LinkedIn-Beitrag, wie man Googles Antigravity (ein KI-Agent von Gemini 3 Pro) nutzt, um Websites anhand der Quality Rater Guidelines (QRG) zu analysieren.

Der Workflow:

Die QRG werden als Markdown-Datei geladen

Antigravity wird mit dem Zielkeyword und der Ziel-URL gefüttert

Anschließend analysiert der Agent in einem echten Chrome-Browser die SERP sowie die Website

Das Resultat: Eine Markdown-Datei mit Bewertungen nach den QRG-Kriterien (z. B. Needs Met, E-E-A-T) sowie ein Analysevideo. Dies ermögliche eine Bewertung der eigenen Seite mit denselben Maßstäben wie Google.

Diese Vorgehensweise ist ein mächtiges Tool zur automatisierten Bewertung einer Website anhand der QRG. Die QRG stellen keine direkten Rankingkriterien dar, aber die Bewertung anhand der Qualitätsrichtlinien von Google liefert wertvolle Erkenntnisse darüber, wie Google eine Website interpretiert. Im Vergleich mit der Konkurrenz können wertvolle Hinweise auf Optimierungsfaktoren identifiziert werden.

Henry Seyffert

Update vom 07.01.2026: CC-Rank als möglicher Sichtbarkeitsfaktor

Eine aktuelle Analyse von Metehan Yesilyurt zeigt, dass der sogenannte CC Rank aus den WebGraph-Daten der gemeinnützigen Organisation Common Crawl möglicherweise als ein Autoritätssignal für die Sichtbarkeit von Websites in KI-Systemen wie ChatGPT fungiert.

Der CC Rank basiert auf der sog. „Harmonic Centrality“ einer Domain im globalen Linknetzwerk und misst, wie zentral und gut vernetzt eine Website ist. Domains mit hoher Zentralität werden demnach häufiger gecrawlt und sind dadurch stärker in den Trainingsdatensätzen der KI-Sprachmodelle vertreten.

Yesilyurt zeigt, dass viele in KI-Antworten häufig zitierte Domains auch im Common-Crawl-Webgraph überdurchschnittlich hohe Autoritätswerte aufweisen.

Der Beitrag erweitert die Diskussion um KI-Sichtbarkeit um eine strukturelle Perspektive jenseits klassischer Onpage- und Content-Signale. Er verdeutlicht allerdings auch den Wert des bereits bekannten Sichtbarkeitsfaktors Autorität. Wichtig ist jedoch, dass es sich bei CC-Rank nur um einen möglichen Einflussfaktor unter vielen handelt.

Alexander Beth

Update vom 05.01.2026: Google Core Update Dezember '25

Glenn Gabe beleuchtet auf GSQI die Auswirkungen des Google Core Updates vom Dezember 2025. Die Analyse zeigt, dass es starke Ranking‑Schwankungen gab, insbesondere in YMYL‑Bereichen (Finanzen, Gesundheit) sowie bei Nachrichten‑Publishern und Foren. So haben in Deutschland die Publisher Stern.de, RP-Online und Testberichte.de sowie die Portale ab-in-den-urlaub.de, gutefrage.net und moviepilot.com die größten Sichtbarkeits-Einbußen zu verzeichnen.

Zudem betont Gabe, dass auch Zitierungen in Google AI Overviews und im AI-Mode betroffen sind, wenn sich die Sichtbarkeit einer Website in der Google-Suche infolge eines Core-Updates verändert.

Das Dezember‑Core-Update unterstreicht Googles anhaltenden Fokus auf Qualität, Relevanz und Nutzervertrauen – vorrangig in sensiblen Bereichen wie Gesundheit, Finanzen und Nachrichten. Selbst etablierte Publisher haben bei mangelnder inhaltlicher Tiefe oder unklarer Expertise Sichtbarkeitsverluste zu befürchten. Gleichzeitig wird deutlich, wie wichtig eine ganzheitliche Betrachtung von SEO für Suchmaschinen und KI-Systeme ist, da Core-Updates auch einen Einfluss auf die Sichtbarkeit in Googles KI-Lösungen haben.

Henry Seyffert

Update vom 02.01.2026: Nutzungsverteilung generativer KI-Tools

Die aktuellen Zahlen des AI Global Reports (Dezember 2025) von Similarweb zeigen, dass der Traffic-Vorsprung von OpenAI gegenüber Google Gemini weiter schrumpft. Während Gemini seit September ein Wachstum von über 60 % zeigt, stagniert oder sinkt OpenAIs Traffic sogar leicht. Überraschend stark wächst Meta AI, teils mit dreistelligen Raten. Betrachtet wurde der Domaintraffic ohne API-Zugriffe – die Werte können also als Indikator für ein öffentliches Nutzerinteresse an den generativen KI-Plattformen verstanden werden.

Häufig gestellte Fragen zum Thema KI und SEO

Wo finde ich relevante Informationen zu den Änderungen von Google?

Google veröffentlicht regelmäßig Informationen rund um neue Produkte sowie Änderungen in den Algorithmen auf Google Search Central.

Welche Neuerungen bietet Google?

Allen voran: Die Integration der künstlichen Intelligenz in die Internetsuche. Mit den AI Overviews und dem für die USA freigegebenen AI Mode kommen weitreichende Änderungen auf die Internetsuche zu.

Wird SEO weiterhin relevant bleiben?

Kurzum: Ja. Die Aufregung rund um die Google Entwicklerkonferenz in der SEO-Branche war riesig. Genaue Aussagen über die Auswirkungen, die die Integration der KI in die Internetsuche haben wird, können noch nicht getroffen werden. Die Grundlagen der Suchmaschinenoptimierung scheinen jedoch weiterhin relevant zu bleiben.